🎯 Le problème : trop de fournisseurs, pas assez de standards

Le marché des LLM en 2025, c'est un zoo. Chaque fournisseur a :

- Son propre endpoint (api.openai.com, api.anthropic.com, generativelanguage.googleapis.com...)

- Son propre format de requête et de réponse

- Sa propre gestion des erreurs, rate limits, et authentification

- Ses propres modèles avec des noms et versions différents

Pour un développeur, ça signifie : N intégrations à maintenir, N clés API à gérer, N formats à parser.

🔌 Appels directs : la méthode classique

Comment ça marche

Vous créez un compte chez chaque fournisseur, obtenez une clé API, et appelez directement leur endpoint.

Appel direct à OpenAI

L'outil call_openai est une fonction asynchrone qui envoie une requête HTTP POST à l'endpoint api.openai.com/v1/chat/completions. Elle authentifie la demande via un header Bearer avec votre clé API, puis construit un payload JSON contenant le modèle cible (par défaut gpt-4o), le prompt, et des paramètres de génération comme max_tokens et temperature. La réponse est parsée pour extraire le texte généré depuis la clé choices[0].message.content.

Appel direct à Anthropic

L'outil call_anthropic fonctionne de manière similaire, mais cible l'endpoint api.anthropic.com/v1/messages. L'authentification utilise un header x-api-key spécifique, accompagné d'un header obligatoire anthropic-version. Le format du payload et de la réponse diffère légèrement : le texte généré se trouve dans content[0].text.

Appel direct à Google (Gemini)

L'outil call_google interagit avec l'API Gemini via generativelanguage.googleapis.com. La clé API est passée directement en paramètre d'URL. Le format du payload est propre à Google : le prompt est encapsulé dans contents[0].parts[0].text et les paramètres de génération sont regroupés sous generationConfig. Le résultat est extrait depuis candidates[0].content.parts[0].text.

Vous voyez le problème ? Trois fonctions différentes, trois formats de requête, trois formats de réponse, trois systèmes d'authentification. Et on n'a couvert que 3 fournisseurs sur des dizaines.

Avantages des appels directs

| Avantage | Détail |

|---|---|

| Latence minimale | Pas d'intermédiaire, connexion directe |

| Moins de dépendance | Un seul point de défaillance par fournisseur |

| Accès immédiat | Nouveaux modèles disponibles dès la sortie |

| Pas de surcoût | Prix fournisseur brut, sans marge |

| Contrôle total | Accès à tous les paramètres, même expérimentaux |

Inconvénients des appels directs

| Inconvénient | Détail |

|---|---|

| Maintenance lourde | N intégrations = N fois plus de code à maintenir |

| N clés API | Une clé par fournisseur à gérer et sécuriser |

| N factures | Un compte billing par fournisseur |

| Pas de fallback natif | Si un provider tombe, votre code crashe |

| Pas de vue unifiée | Difficile de comparer les coûts et l'usage |

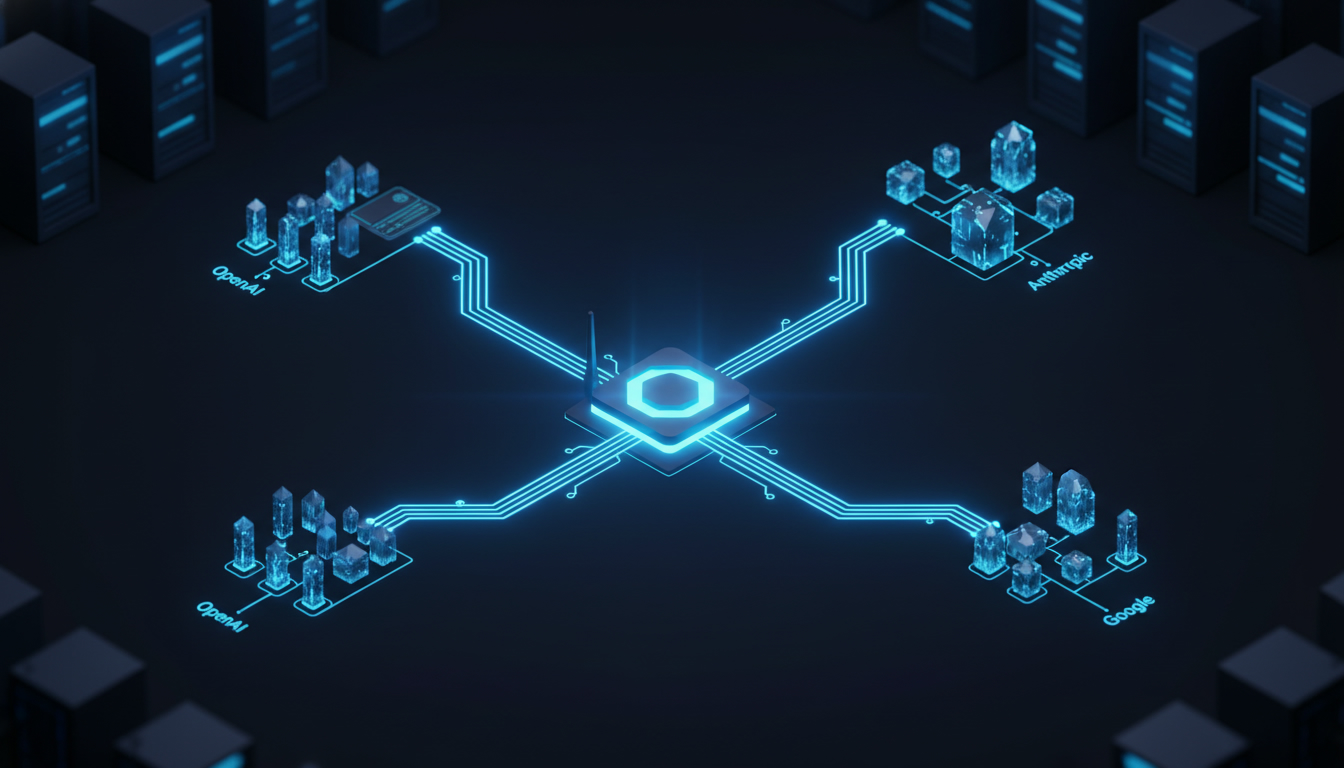

🌐 OpenRouter : l'agrégateur universel

Comment ça marche

OpenRouter est un proxy API qui expose un endpoint unique compatible OpenAI. Vous envoyez vos requêtes à OpenRouter, qui les route vers le bon fournisseur.

Votre code ---> OpenRouter ---> OpenAI / Anthropic / Google / Mistral / ...

Une seule clé API, un seul format, un seul endpoint.

Appel via OpenRouter

L'outil call_openrouter centralise tous les appels vers un seul endpoint (openrouter.ai/api/v1/chat/completions) en utilisant un format de requête identique à celui d'OpenAI. Outre la clé API, il accepte des headers optionnels comme HTTP-Referer et X-Title pour l'identification. L'énorme avantage réside dans le paramètre model : changer de fournisseur revient simplement à modifier une chaîne de caractères (ex: anthropic/claude-sonnet-4-20250514, openai/gpt-4o, google/gemini-2.0-flash). OpenRouter propose même des modèles gratuits suffixés par :free.

Tableau comparatif complet

| Critère | Appels directs | OpenRouter |

|---|---|---|

| Endpoint | 1 par fournisseur | 1 unique |

| Clés API | 1 par fournisseur | 1 seule |

| Format | Variable | Unifié (compatible OpenAI) |

| Latence | Minimale | +50-100ms |

| Fallback | À coder soi-même | Intégré (route auto) |

| Billing | N factures | 1 facture |

| Modèles gratuits | Rares | Oui, plusieurs disponibles |

| Nouveaux modèles | Immédiat | Délai de quelques heures/jours |

| Coût | Prix brut | Prix brut + petite marge (~5-15%) |

| Disponibilité | Directe | Dépend d'OpenRouter |

| Dashboard | N dashboards | 1 unifié |

⚡ Les vrais avantages d'OpenRouter

1. Modèles gratuits

OpenRouter propose des modèles gratuits, parfaits pour le prototypage et les tâches simples. La liste FREE_MODELS inclut notamment des références comme google/gemini-2.0-flash-exp:free, meta-llama/llama-3.1-8b-instruct:free, mistralai/mistral-7b-instruct:free ou encore huggingfaceh4/zephyr-7b-beta:free. Ces modèles sont idéaux pour les phases de développement et de test sans engendrer de coûts.

2. Fallback automatique

Si un fournisseur est down, OpenRouter peut automatiquement basculer. Le mécanisme de fallback route s'active en ajoutant le paramètre "route": "fallback" dans le payload JSON de votre requête. Si le modèle principal (par exemple Claude) est indisponible, OpenRouter redirige automatiquement l'appel vers un modèle de secours équivalent sans que votre code n'ait besoin de gérer l'erreur.

3. Billing unifié

Une seule facture, un seul dashboard pour voir :

- Combien vous dépensez par modèle

- Quels modèles sont les plus utilisés

- Votre consommation en temps réel

4. Comparaison facile

Tester un nouveau modèle = changer une string. Pas besoin de créer un compte, obtenir une clé API, intégrer un nouveau format.

⚠️ Les vrais inconvénients d'OpenRouter

Soyons honnêtes, tout n'est pas rose.

1. Latence supplémentaire (+50-100ms)

Chaque requête passe par un intermédiaire. Pour du chat temps réel, ça peut se sentir. Pour du batch processing, c'est négligeable.

Appel direct: Vous ---- 120ms ----> Anthropic

OpenRouter: Vous -- 50ms --> OpenRouter -- 120ms --> Anthropic

Total: ~170ms (+50ms)

2. Point de défaillance unique

Si OpenRouter tombe, tous vos appels échouent. C'est le risque principal de la centralisation.

3. Disponibilité des modèles

Certains modèles ne sont pas disponibles sur OpenRouter, ou avec un délai après leur sortie. Les modèles très récents ou en preview peuvent manquer.

4. Marge sur les prix

OpenRouter ajoute une marge (généralement 5-15%) par rapport aux prix directs. Sur de gros volumes, ça peut compter.

🏗️ Pattern production : ModelManager avec fallback

Voici le pattern que nous utilisons en production. Il combine le meilleur des deux mondes : OpenRouter en principal, appels directs en fallback.

La classe ModelManager est un orchestrateur complet qui gère des chaînes de fallback. En interne, elle configure trois chaînes par défaut : "smart" (pour les meilleurs modèles, mêlant OpenRouter et appels directs Anthropic/OpenAI), "fast" (pour les modèles rapides et économiques) et "free" (pour les modèles gratuits). Elle maintient un état des rate-limits par provider : lorsqu'un appel renvoie une erreur 429, le provider est marqué comme indisponible pendant la durée indiquée par le header retry-after. La méthode principale complete() parcourt la chaîne demandée, ignore les providers limités, et tente l'appel suivant en cas d'échec.

Les exemples d'utilisation de ce manager se résument à instancier la classe et à appeler la méthode complete avec une liste de messages et le nom de la chaîne souhaitée (par exemple "smart"). Le système se charge silencieusement de trouver le premier modèle disponible et de retourner la réponse, offrant une abstraction totale des pannes de backend.

Comment ça marche ?

- Chaînes de fallback : chaque chaîne (smart, fast, free) définit une liste ordonnée de modèles

- Rate-limit detection : quand un provider renvoie 429, il est marqué comme limité pour la durée indiquée

- Fallback automatique : si un modèle échoue ou est rate-limité, on passe au suivant

- Providers mixtes : une même chaîne peut mélanger OpenRouter et appels directs

📊 Quand utiliser quoi ?

| Situation | Recommandation | Pourquoi |

|---|---|---|

| Prototypage / side project | OpenRouter seul | Un seul compte, modèles gratuits, rapide à setup |

| Production avec 1 modèle | Appel direct | Moins de latence, moins de dépendance |

| Production multi-modèles | OpenRouter + fallback direct | Meilleur des deux mondes |

| Gros volumes (>100k req/jour) | Appels directs | Économie sur la marge OpenRouter |

| Budget serré | OpenRouter modèles gratuits | Zéro coût pour les modèles free-tier |

| Tests / comparaison modèles | OpenRouter | Changer de modèle = changer une string |

🔧 Configuration dans OpenClaw

Si vous utilisez OpenClaw sur votre VPS, la configuration des providers est simple. OpenClaw utilise nativement OpenRouter. La configuration se présente sous forme d'un fichier YAML déclarant la clé API OpenRouter via une variable d'environnement et le modèle par défaut. Vous pouvez y ajouter une section de fallback direct optionnelle pour Anthropic, en y injectant sa propre clé API sécurisée. Si vous cherchez à déployer cette stack, notre article sur le VPS + IA : le setup complet pour tout auto-héberger détaille l'installation serveur, et le guide Docker + IA : conteneuriser ses services intelligents explique comment isoler tout ça dans des conteneurs.

❌ Erreurs courantes

- Ignorer les rate limits : Appeler un provider sans gérer les erreurs 429 finit par bloquer votre application. Utilisez toujours un système de détection comme celui du ModelManager.

- Hardcoder ses clés API : Ne laissez jamais vos clés en clair dans le code. Passez systématiquement par des variables d'environnement.

- Oublier le fallback : En production, un seul fournisseur tombera tôt ou tard. Prévoyez toujours une chaîne de secours.

- Sous-estimer la latence OpenRouter : Sur des applications synchrones très sensibles (ex: génération vocale en temps réel), le surplus de 50-100ms peut être rédhibitoire.

📋 L'essentiel

- Appels directs offrent latence minimale et contrôle total, mais demandent une maintenance lourde (N intégrations, N clés).

- OpenRouter unifie tout en un seul endpoint, une seule clé, un seul format, au prix d'une légère latence et d'une marge sur les prix.

- Le pattern ModelManager combine les deux : OpenRouter en primaire, appels directs en fallback, avec gestion intelligente des rate limits.

- Pour commencer, foncez sur OpenRouter. Pour scaler, ajoutez des fallbacks directs.

❓ FAQ

OpenRouter est-il fiable en production ?

Oui, mais comme tout intermédiaire, il peut subir des coupures. C'est précisément pour cela qu'il est recommandé de coupler OpenRouter avec des appels directs en fallback.

La marge d'OpenRouter est-elle pénalisante ?

Elle se situe entre 5 et 15%. Pour des petits volumes ou du prototypage, c'est négligeable. Au-delà de 100 000 requêtes par jour, il devient plus rentable de passer aux appels directs pour les modèles les plus sollicités.

Peut-on mixer OpenRouter et des appels directs dans le même projet ?

C'est même la recommandation pour la production. Le pattern ModelManager présenté dans cet article fait exactement cela.

Les modèles gratuits d'OpenRouter ont-ils des limites ?

Oui, ils sont soumis à des rate limits plus strictes et peuvent être plus lents. Ils sont parfaits pour du développement ou des tâches non critiques, mais à éviter pour un service client en production.

🎯 Conclusion

Pour la plupart des projets self-hosted :

- Commencez avec OpenRouter -- c'est le plus simple et le plus flexible

- Ajoutez des appels directs en fallback pour vos modèles critiques

- Utilisez le pattern ModelManager pour gérer automatiquement les pannes

- Surveillez vos coûts via le dashboard OpenRouter et ajustez

Le pattern est testé en production. À vous de jouer.

🛠️ Outils recommandés

- OpenRouter : L'agrégateur d'APIs IA incontournable pour unifier vos appels.

- Cloudflare Tunnel : exposer ses services sans ouvrir de ports : Pour sécuriser l'accès à vos APIs locales si vous exposez des webhooks.

- VPS + IA : le setup complet pour tout auto-héberger : Le guide de référence pour préparer votre infrastructure.

- Docker + IA : conteneuriser ses services intelligents : Pour isoler et déployer vos agents IA facilement.